Intro

Contents

Generative model

은 단순한 생성 모델 뿐만이 아니라 더 큰 개념

Q. 강아지의 이미지가 주어졌을 때 Generative model은 어떤 것을 할 수 있을까..?

- Generation: 강아지를 Training Data로만 샘플링하는 것 (sampling)

- Density estimation이란 [P(x) 우리가 학습한 이미지]가 들어올 때 확률 값을 받아들여 분류하는 개념이다. (anomoaly detection)

- Unsupervised represntation learning: 각 특징 별로 구분(feature learning)

Generation과 Density estimation이 가능한 모델, 확률값을 얻어낼 수 있는 모델을 explicit model이라 부름

! Summary: Generation ⊃ Density estimation

Q. P(x)를 어떻게 만들까...?

# Discrete Distributions(정해진 값)

Bernoulli는 0 또는 1, 이 확률분포를 표현하는 숫자는 하나!

Cateogorical는 m개, ex)주사위 m-1로 필요

! Summary: 엄청나게 많은 parameters가 필요하고 많기에 학습은 더욱 어렵다.

parameters를 줄이기위해, 학습을 원활하게 하기 위해 독립적이라고 가정을 한다.

2^n -> n 으로

Fully와 Independence의 gap이 크다. 그래서 Conditional Independence를 적용한다.

Conditional Independence

! Summary: Conditional Independence는 효율적으로 parameters 수를 적용시킬 수 있다. number: 2n-1

Conditional Independence를 잘 활용한 모델, Auto-regressive Model

Auto-regressive Model

#variability of parameters #Ordering

! Summary: NADE(explicit model)은 단순히 generation만 하는 것이 아니라, 임의의 출력값의 확률을 계산할 수 있다.

+ In case of modeling continuous random variables, a mixture of Gaussian can be used. (가우시안)

Pixel RNN 또한 Auto-regressive model이다.

R이 G에 영향을, 그 다음은 R,G가 B에 영향을.

Pixel RNN은

- Row LSTM

- Diagonal BiLSTM

으로 나눌 수 있는데, Row LSTM은 R번째 픽셀을 만들 때 위쪽에 있는 것을 활용하고

Diagonal BiLSTM은 이전 정보를 포함해서 연결됬다고 생각하면 된다.

Variational Auto-encoder

- Posterior distribution

- Variational distribution

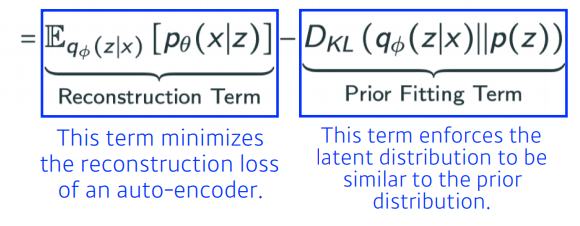

Posterior는 계산할 수 없지만 ELBO는 계산할 수 있기 때문에 인코더로 근사값을 찾을 수 있다.

따라서 Variational Auto-encoder 에서 ELBO를 계산해서 값을 증가시켜 원하는 반대급수를 조절한다.

isotropic Gaussian(가우시안)을 활용한다.

#VA ≠ explicit model

Adversairal Auto-encoder

가우시안을 사용하고 싶지 않을 때, GAN을 활용해서 latent distributions 사이의 분포를 맞춰준다.

GAN

GAN은 예시로 창과 방패의 대결, 모순을 통해 generator와 discriminator가 더욱 정교해진다.

True generator 과 내가 학습하고자 하는 geneartor의 사이에 diverse를 최소화하기 위한 수식을 사용한다.

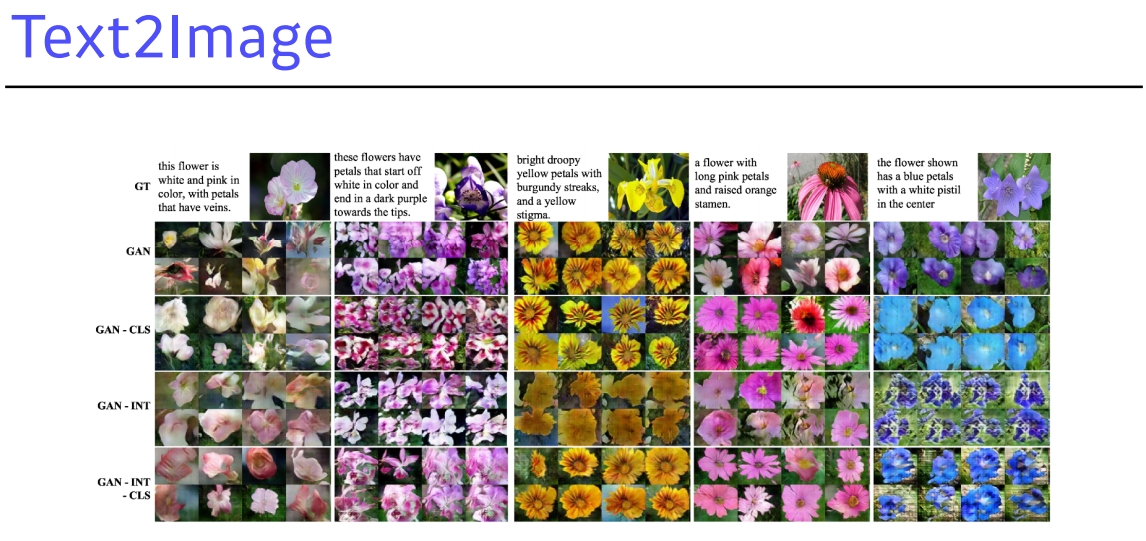

GAN을 활용한 것.

- Text2Image

Literally, Text를 Image로 변환시킨다!

- CycleGAN

야생에 있는 얼룩말의 데이터와 말의 데이터들이 잇으면 CycleGAN 2번의 움직임으로 변화한다.

- Progressive-GAN

저차원부터 고차원까지 점차 늘려가면서 학습. Progressive Training

Peer-session

- Statics Study

Summary statics and independence

공분산

가우시안통계

Review

Richard Feynman이 Generative Models 개념의 시초를 구상하신 분이라니, 새삼 다시 놀랐다.

Generative model은 GAN만 생각해왔었는데, 스펙트럼이 넓구나라고 느낀다.

GAN에서는 많은 GAN type이 존재한다. 사실 GAN에 대해서 아직까지도 GAN과 관련된 논문들이 쏟아져 나오고 있고, GAN 뿐만이 아니라 ML, DeepLearning에서 그렇다한 정답이 존재하지 않는다고 생각한다. 그것이 A.I관련해서 논문을 필수적으로 체킹해야 하는 이유가 아닐까?

References

1. NAVER connect Foundation

2. NADE(Neural Autogressive Density Estimator) paper

'IT개발 > A.I 인공지능' 카테고리의 다른 글

| 데이터 시각화_기초 (0) | 2021.08.14 |

|---|

Comment